2026.3.19 加筆修正、タイトル変更

さて、前回に引き続いての近況報告で御座います。

海外での算数道場

仕事の都合でインド出張が多くなっており、従業員の子供達向けに算数道場を開催しております。

従業員の子供達は7歳~14歳の5名ほどでして、私が出張中の期間、算数,数学の指導をしております。

教材は英語で作成しており、英語を教えながら、算数,数学の指導を進めている感じです。

※子供達の英語力は御家庭によって様々ですが、英語力の高いお子様も多いです。

インド全土では恐らくそこまで英語理解率は高くありませんが、事務所が都会な影響もあるかもしれません。

子供達の算数,数学の能力ですが個人差はありますが、計算が得意な子供が非常に多い印象です。

とにかく暗算が早いですね。

これは学校教育の影響な気がしますが、インドでは計算能力に注力したカリキュラムになっているようです。

ソロバンなみとは言いませんが、必要充分なレベルの暗算力を身に付けているお子様が殆どですから、算数/数学の指導自体はかなり捗ります。

長期間インドにいられる訳ではありませんので、自学自習の進め方の指導が中心です。

教材の進め方、分からなかった時の聞き方、Sharari-manへの問い合わせの仕方などです。

日本ほど娯楽が多くありませんので、子供達は割と楽しそうに学習に取組んでくれます。

『教材全部終わっちゃったから、新しい教材が欲しいです』

Sharari-man

Sharari-man早いね~。凄いね!じゃあ次はもっと楽しい教材を送るね。

あなたの成長がとっても楽しみです。

このような会話をする事が多いです。

日本での道場生の指導と殆ど同じですね。子供達の『楽しい』を上手く引き出し、『共に成長する』という意識で取組んでおります。

英語での教材作成は出張移動中の時間、休日などを利用して作成しておりますが、自身の英語力向上にも役立ち、中々有意義な仕事だと感じています。

このような趣味や自身の楽しみを通じた英語学習であれば、楽しみながら進められますのでオススメです。

どこに行っても、子供達の指導というのは楽しいものです。

私自身はあと10年、20年もすれば、亡くなり、いなくなるのでしょうが、自身の経験や知識は子供達を通じてこの世界に残り続け、子供達の中にも楽しい思い出として残る。

そう思いますと、何だか感慨深いと言いますか、もっと楽しく学んだ思い出を子供達に残してあげたいなぁと思う訳です。

Sharari-man

Sharari-manどうでしょうか?

ちょっと変わっていますかね?

教材作り、子供達の指導を通じて辛いなぁ、苦しいなぁと思う事は殆ど無いのですよね。

楽しい趣味に取組んでいる感じです。

今は他に率先して取り組みたい事は仕事上の開発業務くらいしかありませんので‥‥。

さて、少し忙しいので、続きはまた後で書きたいと思います

続きはAI関連の事について書いてみようと思います。

AIと呼ばれる物の構造

Sharari-man

Sharari-manさて、AIと呼ばれる物は一体何なのか?

初学者の方にもわかるようにベーシックなところから解説してみようかと思います。

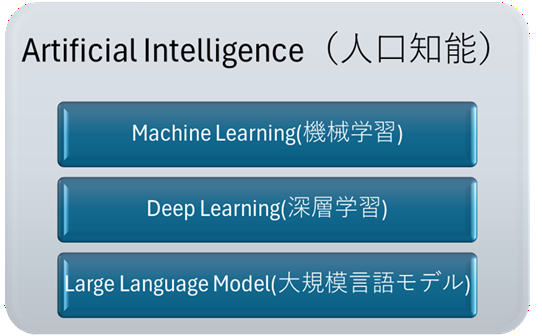

さて、人口知能という言葉は一般に広く認知されておりますが、その中身(技術構成)については御存知ない方も多いでしょう。

様々な技術要素が組み合わされてAIと呼ばれるものになっていますが、主要なものとしては以下の技術要素が挙げられます。

【機械学習 Machine Learning ⇒ ML】

人間が解を与えるのではなく、機械が機械に与えた複数のデータから経験則として解を得られるよう自律的に行動します。

これを人間の行動に当てはめると 『学び』 となりますから、機械学習と呼ばれています。

具体例としては 『これは車の画像です』と伝え大量の車の画像を読み込ませる事で、それらの写真から『車』と思われる物の特徴量を自動的に抽出し、『その特徴を持つものが車だ』と経験則として認識する事です。

【深層学習 Deep Learning ⇒ DL】

深層学習も良く聞く言葉の一つですが、技術としては機械学習と呼ばれるものの中の1つです。

人間の脳を模倣した学習システムであり、入力層,隠れ層,出力層から構成され、隠れ層を多層化したシステムが主として用いられます。

関連用語としては

CNN 畳み込みNN(ニューラルネットワーク)⇒数値やデータの処理が得意

DNN 深層NN ⇒画像処理が得意

RNN 再帰NN ⇒文章、音声処理が得意

などが挙げられます。興味がある方は調べてみて頂けましたら!

【大規模言語モデル Large Language Model ⇒ LLM】

上に挙げた深層学習技術を応用し、言語処理に適用する事で文章の理解や生成を可能にした技術をLLMと呼びます。

歴史的には初期型の『N-gram』という技術モデルからスタートしたように思います。

本技術は2017年頃に発表されたグーグル社の『Transformer』によって大きな進化を見せる事となります。

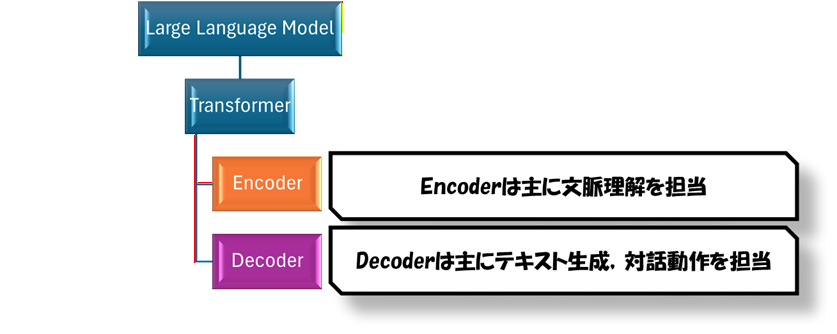

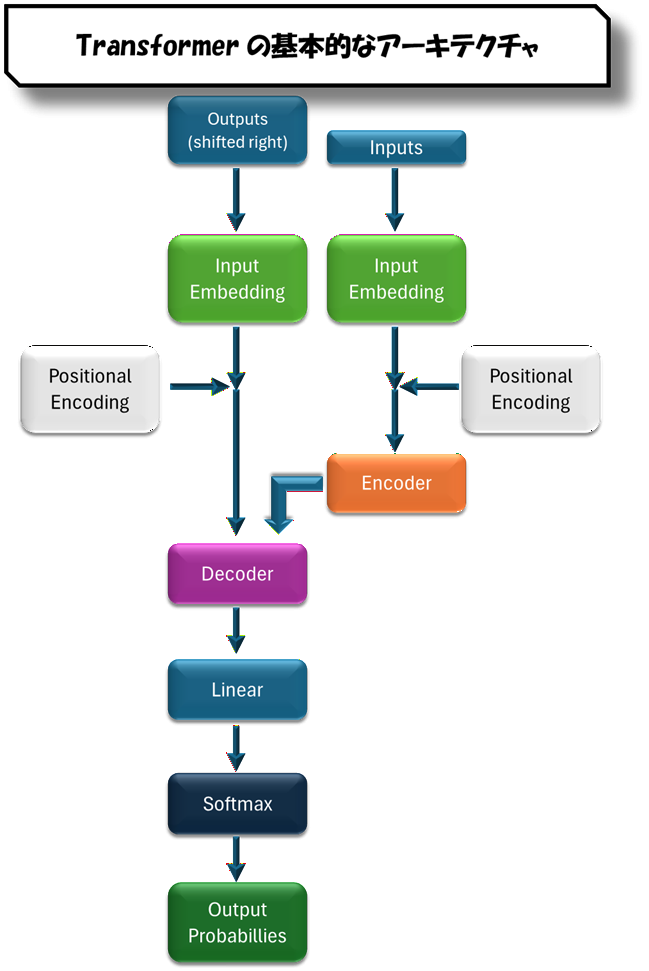

近代的なLLMの構造 Transformer

さて、2017年頃にTransformerが登場した事によってLLMは大きな進化を遂げる事になります。

【Transformer】

本技術が登場するまでの技術的課題として、文脈理解、長文理解、因果関係の理解が難しいという問題がありました。

例えば受験の国語に登場する『それ が何を指すか?』のような問題において、『それ』と『解』の物理的な距離(文字量)が遠ければ遠いほど、解を得る事がコンピューターにとって難しいという事です。

これは現在においても完璧に解決された訳ではありません。AIも人間と同様に長い文章に存在する単語同士の因果関係を完璧に理解するのは難しいという事です。

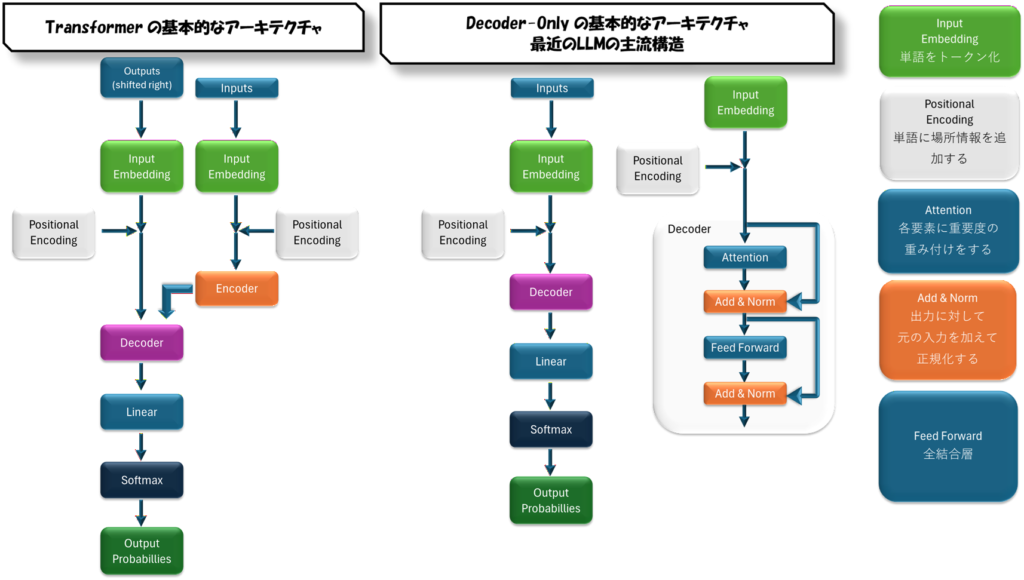

Transformer は文中に存在する全ての単語の因果関係を同時並行に処理する『Self-Attention』と呼ばれる機構を採用した事が特徴です。

これによって文脈理解の精度が大幅に向上し、現在運用されているChat-GPTやGeminiなどの原型が出来上がりました。この同時並行処理を行うLLMは保有パラメータ数、計算量がそれまでのものと比較して桁違いに大きくなりました。例えばChat-GPTなどは数千億以上のパラメータを持っていると言われています。

ちなみにこの同時並行処理という作業が得意なのがいわゆるGPUと呼ばれる商品です。GPUはCPUと比較して並列計算が得意なシステムであり、LLMのように大量のデータを並列処理する仕組みに適しています。

AI半導体と呼ばれる物の多くはこういった『並列計算処理が得意な半導体チップ』と言い換える事が出来るかと思います。

さて、このような特徴を持つLLMによって、これまで別の計算モデルで実行していた処理をLLMだけで実行出来るようになりました。例えば翻訳、対話、計算などの作業です。

言語理解が可能な『汎用処理モデル』が誕生したと言えるでしょう。

現代においてはEncoder と Decoder のうち Encoderが存在しない Decoder-Onlyが主流になってきています。

Decoder-Onlyの詳しい説明は省きますが、主に『構造のシンプルさ』『学習コストの低さ』などが採用要因のように思います。他にも要因は色々ありますが、この二つは商業として成り立たせる上で重要なポイントですね。

Self Attention

【Self-Attention】は大規模な並列計算によって各単語同士の関連性に重み付けを行い、その重みに基づいて情報を統合するシステムです。

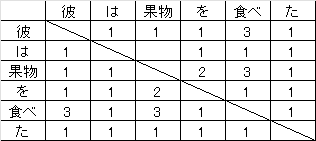

名詞、代名詞、助詞、形容詞、動詞などの品詞毎に分解し、それぞれの関係性を判断するイメージを持ってもらえば良いでしょう。

彼は果物を食べた。それはリンゴだ。という文章の場合

彼/は/果物/を/食べ/た/。それ/は/リンゴ/だ/。

このような形に分解され、果物-それ-リンゴは関連性が高い=重い という形で重み付けを行います。

これらの関連性の計算は それぞれの単語に対して網羅的かつ同時並行に実施されます。

下図のようなイメージで重み付けがなされます。※あくまでイメージです。

この処理によって文章に使用されている各語の関連性についてAIは定量的に評価する事が可能となり、文章を作成する能力を獲得しました。

AIの回答の仕組み

さて、上述したような仕組みでAIは言語を『理解』したように見えます。

しかしながら、実際のところ、AIが出してくる回答は以下のような確率論に基づいて数学的に処理されています。

次の授業は‥‥に続く言葉は何か? という命題に対して、正答である確率が高い単語を選んでいるというイメージです。

このような確率論に基づき、会話が成り立つ可能性が高い物を出力しているというのが現状です。

そのため、現代のAIは平気で嘘をつく事もあります。

Sharari-man

Sharari-manさて、後日加筆修正を行い、もう少しAIの構造について詳しく解説する予定です。

本日はここまで!

AIが当たり前に傍にいる時代で

Sharari-man

Sharari-manさて、このような部分的には人間の処理能力を大きく超えたAIが傍にいる時代になりました。

このような時代において、数学力、プログラミング力は役に立つのでしょうか?

Sharari-man

Sharari-manSharari-manは当たり前に『当然役に立つ』と考えています。

Sharari-man

Sharari-manAIがどこまで進化していくかは現段階では分かりませんが、人間が何も考えないで良い時代が来るまでにはまだまだ長い時間がかかります。

Sharari-man

Sharari-manロボット+AIのフィジカルAIと呼ばれる分野の進化も進んではいますが、まだまだ人間に取って代わるほどではありません。

Sharari-man

Sharari-manAIはまだまだ万能ではありません。部分的には人間を超える能力を獲得していますが、まだほんの一部です。

どんな作業も器用にこなす汎用性、全体構造を見据えた論理的かつ合理的な判断力などはまだまだ人間とは大きく乖離しています。

AIと人間を比較してAIが得意な物は何かを理解し、上手く分業するためにはどうすれば良いか?を人間が考えなければなりません。

Sharari-man

Sharari-manこのような論理的/合理的な考え方を身に付けるために数学やプログラミングの学習は大変役に立ちます。

また、実際のAIの挙動自体も数学によって裏打ちされたプログラムによってもたらされている訳ですから、仕組みを理解するために一定の能力が必要です。

Sharari-man

Sharari-manプログラミング/コーディングというスキルだけで食べていける時代は終わりをむかえる可能性はあります。

しかしながら、ソフトウェア仕様の決定、AIの活用、全体構造の調整といった点はまだまだ人間の関与が必要であり、これらを総合的に検討するためにはプログラミング/コーディングのスキルも必要です。

Sharari-man

Sharari-manまだまだ人間がAIの成長をサポートしていく必要はありますから、人間側もまだまだ学ぶ余地はあります。

Sharari-man

Sharari-manAIの登場によって『調べる』という作業は劇的に低コストになりますから、その分のリソースを論理的思考力を身に付ける方向にまわすという事も良いでしょう。

さて、このように、AIが傍にいる時代が到来したとしても、人間が学び続けていく必要はあると考えています。

如何でしょう?上で述べたのはAIの基本的な構造ですが、御存じでしたでしょうか?

『このような仕組みについて知らないのにAIの回答を鵜呑みにする』

というのは中々に危険だとも考えています。

受験科目に『情報』が追加されておりますが、こういった現代的な技術について、高等学校で学べる時代が来ると良いなとは思っています。

古文、漢文、歴史などとトレードオフにして、情報や工学を学ぶというように、高等教育以降はより専門性を持たせた学習を子供達に与えた方が良いのでは?とも考えています。

今後の文部科学省の動きにも注目していきたいところです。

また、後日追記致します。

我が家の学習事例が少しでも家庭学習に取組む皆様の御参考になりましたら望外の喜びです。

ではまた!

コメント【コメント非公開、メールでの返信を御希望される方はその旨をご記入下さい】